文章目录 前言Maintenance stateMaintenance state的场景匹配Maintenance state的差别改造参考链接 前言 在HDFS集群运维过程中,我们经常会遇到机器送修的情况,尤其在集群机器数量比较多的情况下,每天因为坏盘或是其它硬件问题导致的机器维修是很常见的。对于集群维护者来

(1)客户端通过Distributed FileSystem模块向NameNode请求上传文件,NameNode检查目标文件是否已存在,父目录是否存在。 (2)NameNode返回是否可以上传。 (3)客户端请求第一个 Block上传到哪几个DataNode服务器上。 (4)NameNode返回3个DataNode节点,分别为dn1、dn2、dn3。 (5)客户端通过FSDataOut

在hdfs的web页面中下载到windows不成功 本人在学习的时候跟着操作一模一样,反复看了无数遍都没有不一样的地方,但就是下载不了一点就变成无法访问,在web页面中想要将上传的文件下载下来找了很多文章发现在windows中没有这个虚拟主机名和ip的映射就解析不出来 我在这里使用的火

数据正成为世界上最有价值的资源,分布式文件存储是应对数据爆炸的最好解决方案,那就会涉及到分布式文件存储方案、选型、架构设计等。 分布式文件存储的来源 在这个数据爆炸的时代,产生的数据量不断地在攀升,从GB,TB,PB,ZB.挖掘其中数据的价值也是企业在不断地追求的终极目标。但是要

NameNode的主要职责是记录用户存储数据的数据元信息 元数据:文件块,文件存储位置,块大小,副本的个数,文件的权限...... 记录元数据的形式由两种 元数据存储在内存上:内存对象 元数据存储在磁盘上:内存对象的序列化文件 当客户端对HDFS上的数据进行操作以后,数据的元数据

1.HDFS的数据流 HDFS写数据流程 剖析文件写入 (1)客户端通过Distributed FileSystem模块向NameNode请求上传文件,NameNode检查目标文件是否已存在,父目录是否存在。 (2)NameNode返回是否可以上传。 (3)客户端请求第一个 Block上传到哪几个DataNode服务器上。 (4)NameNode返回3个DataNode

一、问题描述: 任务逻辑是通过实时读取Kafka数据,一分钟计算一次数据,并利用Flink StreamingFileSink将数据落地到HDFS文件中。为了应对大促剧增的数据量,对当前运行稳定的集群进行了扩容处理,任务重启后发现写入的hdfs文件一直处于inprogress状态无法滚动生成正式文件。 任

出处(官方文档) https://hadoop.apache.org/docs/stable/hadoop-project-dist/hadoop-common/SingleCluster.html#Download 下载(官方) https://dlcdn.apache.org/hadoop/common/hadoop-3.3.1/ hadoop-3.3.1.tar.gz 配置环境(重要) 查看jdk安装目录 cat /etc/profile export JAVA

Hadoop是一个由Apache基金会所开发的分布式系统基础架构。用户可以在不了解分布式底层细节的情况下,开发分布式程序。充分利用集群的威力进行高速运算和存储。Hadoop实现了一个分布式文件系统( Distributed File System),其中一个组件是HDFS(Hadoop Distributed File System)。HDFS有高

启动,关闭 D:\hadoop-2.8.3\hadoop-2.8.3\sbin>start-all.cmd D:\hadoop-2.8.3\hadoop-2.8.3\sbin>stop-all.cmd start-all.sh等价于start-dfs.sh + start-yarn.sh 单进程启动。 sbin/start-dfs.sh --------------- sbin/hadoop-daemons.sh --config .. --hostname .. sta

博主最近在安装CDH的时候,发现每次安装都跟逛海南之家一样,每次都有新问题。 这次的impala又出问题了,重装了agent还是有问题,发现这个办法可以,分析一下。 感谢原文大佬的分享:原文链接:https://cloud.tencent.com/developer/article/1079075?from=15425 1.安装cdh集群时候,有一台

问题描述: 通过50070发现无法访问hdfs,因为服务器被重启过, hdfs没有启动。 启动hdfs,但是jps发现没有namenode,查看hadoop/logs/xxxx.log发现: Storage directory /tmp/hadoop-abc/dfs/name does not exist 原因是重启后服务器删掉了/tmp下的数据。 解决方法: hdfs namenode -form

文章目录 Flume入门案例一:监控端口数据1)案例需求2)需求分析3)实现步骤 Flume入门案例二:实时监控单个追加文件1)案例需求:2)需求分析3)实现步骤 Flume入门案例三:实时监控目录下多个新文件1)案例需求2)需求分析3)实现步骤 Flume入门案例四:实时监控目录下的多个追加文件1)案例需求2)需求

对一个大表进行了30个天分区的查询, spark客户端显示了所有excutor均已执行完毕. 查看hdfs分区也显示已有数据, desc表名显示表还没作成. 于是用 hadoop fs -ls 看了下hdfs文件数发现有上万个小文件. 导致合并查询结果时间巨长 小文件过多会导致文件系统效率低下.我们可以在写spar

说明:统计HDFS文件数量大小,小于20M文件数量 1、HDFS 相关命令 # 统计文件大小 hdfs dfs -du -h / # 统计文件数量,返回的数据是目录个数,文件个数,文件总计大小,输入路径 hdfs dfs -count / #统计所有文件的信息,过滤文件夹, 只统计文件,因为使用-ls -R 之后,可以看到文件是”-“

https://blog.csdn.net/zhangcongyi420/article/details/122152090 ——————————————————————————————————————————————————————————— 版权声明:本文为CSDN博主「小码农叔叔」的原创文章,遵循CC 4.0 BY-SA版权协议 原文链

简介 定义: HDFS(Hadoop Distributed File System),它是一个文件系统,用于存储文件,通过目录树来定位文件;其次,它是分布式的,由很多服务器联合起来实现其功能,集群中的服务器有各自的角色。 HDFS的使用场景:适合一次写入,多次读出的场景。一个文件经过创建、写入和关闭之后就不需要改变。 优

上一篇文章中,我们讲到了在异步创建锁节点的回调函数中,会去根据状态码调用becomeActive或becomeStandby。如下图所示: 这两个函数的功能分别是让NameNode变为Active状态和Standby状态,本文我们就来看看这两个函数。 一、becomeActive private boolean becomeActive() {

目录 前言1. 背景2. 动态扩容、节点上线2.1 新机器基础环境准备2.1.1 主机名、IP2.1.2 Hosts映射2.1.3 防火墙2.1.4 SSH免密登录2.1.5 JDK环境配置 2.2 Hadoop配置2.2.1 DataNode负载均衡服务 3. 动态缩容、节点下线3.1 添加退役节点3.2 刷新集群3.3 手动关闭DataNode进程

文章目录 1. 概念2. Hive与Hadoop的关系3. Hive中的命令3.1 创建数据库并指定hdfs存储位置3.2 修改数据库3.3 查看数据库信息3.4 创建表并指定字段之间的分隔符 4. Hive中的四种表结构4.1 内部表4.2 外部表4.3 分区表4.4 分桶表 1. 概念 Hive是基于Hadoop的一个数据仓库

第一章 HA 概述 (1)所谓 HA(High Availablity),即高可用(7*24 小时不中断服务)。 (2)实现高可用最关键的策略是消除单点故障。HA 严格来说应该分成各个组件的 HA机制:HDFS 的 HA 和 YARN 的 HA。 (3)NameNode 主要在以下两个方面影响 HDFS 集群 NameNode 机器发生意外,如宕机,集群将无法使用,

win下访问linux系统的hadoop,访问拒绝, 1.防火墙阻止问题 centos7关闭防火墙:systemctl stop firewalld.service 2.关闭防火墙后还访问不了,需要考虑hadoop是否有开放权限连接。 Win下Eclipse提交hadoop程序会出错:org.apache.hadoop.security.AccessControlException: Permission deni

一、Hadoop入门 1、常用端口号 hadoop3.x HDFS NameNode 内部通常端口:8020/9000/9820 HDFS NameNode 对用户的查询端口:9870 Yarn查看任务运行情况的:8088 历史服务器:19888 hadoop2.x HDFS NameNode 内部通常端口:8020/9000 HDFS NameNode 对用户的查询端口:50070 Yarn查看任务运

HDFS是Hadoop为了储存海量数据而使用的一种分布式文件系统。这种文件系统是运作于多个机器之上的。 HDFS为了保证数据储存的可靠和读取性能,会把保存的数据进行切块后进行复制并且储存在集群的多个节点中。 HDFS存在名字节点NameNode和数据节点DataNode: NameNode:储存元数据信息,也

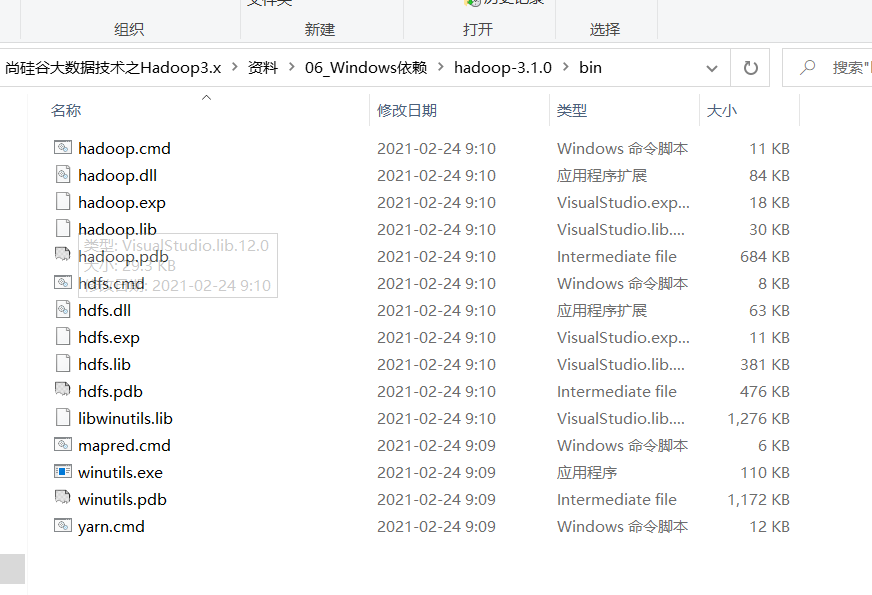

文章目录 1)准备好hadoop相关的资料包2)配置环境变量4)在IDEA创建一个Maven工程HDFSClient(注:若不会初始配置Maven,可参照:https://www.bilibili.com/video/BV1Kr4y1T7zB?spm_id_from=3